外部ライター ワンフットシーバス 田中正吾です。今回はenebularをHoloLens Edgeブラウザで複数モニタリング表示した考察です。

「昨年にIoT可視化してみて考えたこと」という登壇を先日しまして、より情報が伝わる分かる化として模索していきたいということで、今年はグラフの見える化の手法を試してより良くできないか、という想いがあります。

その一環として、見える化のアプローチを模索する上で、ディスプレイ上では飽和してしまいそうなグラフが、自由な空間(=視野)であるMixture Reality機器であるMicrosoft HoloLens でのEdgeブラウザで複数モニタリング表示してみて、まずは感覚をつかんでみようと思います。

センシングをMilkcocoa経由で送れば、Node-REDで料理し、たくさんの可視化ができるまさにenebularはうってつけでして、この検証をしてみます。

HoloLensでenebularにそもそもアクセスできるか

まず、enebularにそもそもアクセスできるかのテストです。

無事、アクセスできました。GitHubログインを私は利用していますが問題なく利用できてます。

ではためしてみる

今回はまずは最小のお試しということで以下のように実験します。

以前の記事で使ったスイッチサイエンス製のESPr Developerを利用してGroveセンサーで色々空間を計測します。

- 1台目

- 温度・湿度センサー

- 空間の快適さを計測するイメージ

- 超音波距離センサー

- 空間内の物体や人の接近把握するイメージ

- 2台目

- アナログ明るさセンサー

- 空間の明るさを計測するイメージ

- LED

- 今後なんらかの通知を受け取る(今回は登場しない)

これをMR空間でモニタリングしてみましょう。

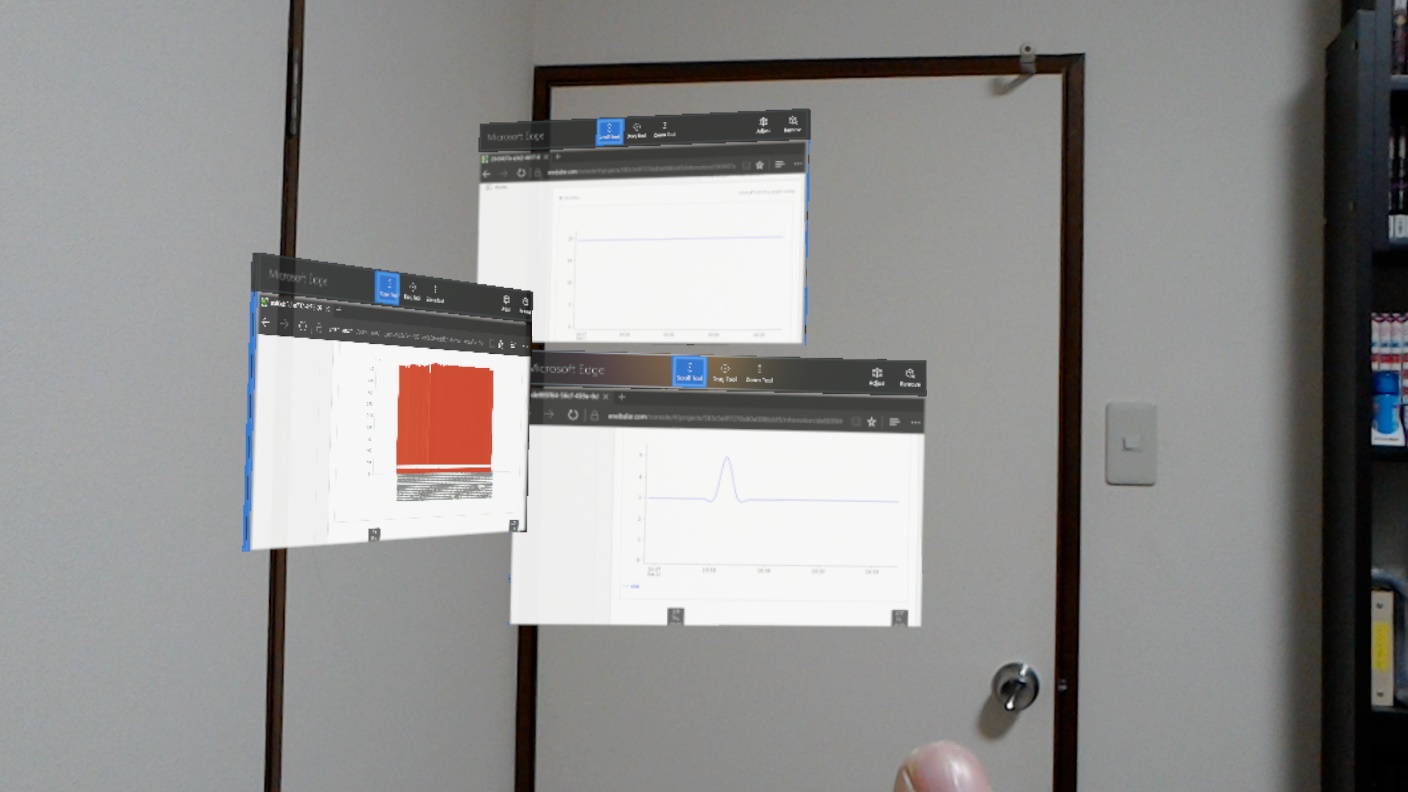

EdgeブラウザをMixture Reality空間に配置

Edgeブラウザをタブで複数表示した後に、そのタブを新しいウィンドウとして分離して配置します。

無事できました。今回は同一の視野の中でやってみます。時計回りに、気温グラフ・人の接近グラフ・明るさセンサーグラフとなっています。リアルタイムモードにしてモニタリングしています。

3タブまではスリープせずに同時に動いているので、今回はこれでやっています。

すでに、人の接近グラフは少し反応していますね!

ということで、動画です。

画質乱れているのはHoloLensのキャプチャの妙でして、実際に見えるものはそれぞれのグラフがハッキリ見えてわかりやすいです。

やってみた考察

そのあと、色々と試しまして、考察としてまとめると以下のとおりです。

- 3D空間内でブラウザを表示する形ではあるが、3D空間のため、現実で言うと「ディスプレイごとにグラフを1表示する贅沢な使い方」になる。

- 今回は視野内に行ったが、Mixture Realityの良さをより良くするなら、まさに現実でディスプレイを置くように、空間上のどこでもおけることがユーザビリティに活かせそう。

- たとえば、見たいグラフによって場所を分けて配置し、インテリアの配置のように配置によってその人の欲しい情報の取捨選択ができそう。さきほどよく稼働した接近グラフは見えるところにおいて、気温グラフはサラリとみるので隅においておくような使い方。

- 今回はすばやい実験のためEdgeブラウザを利用したが、Unityで作ったアプリで板状のものにテクスチャとしてグラフを貼れば、もっと多くのグラフが表示できていろいろな検証ができそうなのでやってみたくなる。

- Mixture Realityの場合、現実空間も見える形で情報がマッピングされるので、例えば、グラフだけでなく接近するとアラートを出すような動きをenebularとNode-REDでつくったり、はたまた、センサー設置場所にセンシング数値がテキストとしてマッピングされると言った見せ方もわかりやすさが増しそう。

- ディスプレイでは飽和するかもしれない情報がMixture Realityにすると上手く整理できるかもしれない?ただ、やりすぎると結局ごちゃごちゃするかも?部屋が散らかるような現象が起きそう。

- ともあれ、現実の建物管理室のように、その機能に特化した空間(部屋)に対して、特化した情報マッピングを行う場合は、通常の生活シーンとは混ざって混乱するようなことはなく使える可能性を感じる。

といった、Mixture Realityにおいて複数モニタリング表示したときの効用について、可能性の感じるものになりました。

今回の考察からいろいろと試していきたいことが出てきましたので、enebularとMixture Realityの実験、また折を見て報告してまいります。